Mais de 60% das pessoas acreditam que inteligências artificiais como o ChatGPT sentem emoções de verdade, segundo pesquisa da Pew Research Center de 2024. Mas aqui vai o choque: nenhuma IA atual possui sentimentos genuínos. Elas simulam respostas emocionais com maestria, mas não experimentam alegria, tristeza ou medo.

Este artigo desmonta o mito da IA emotiva, explica a diferença entre simulação e consciência afetiva, e mostra por que essa confusão importa para ética, psicologia e o futuro da tecnologia.

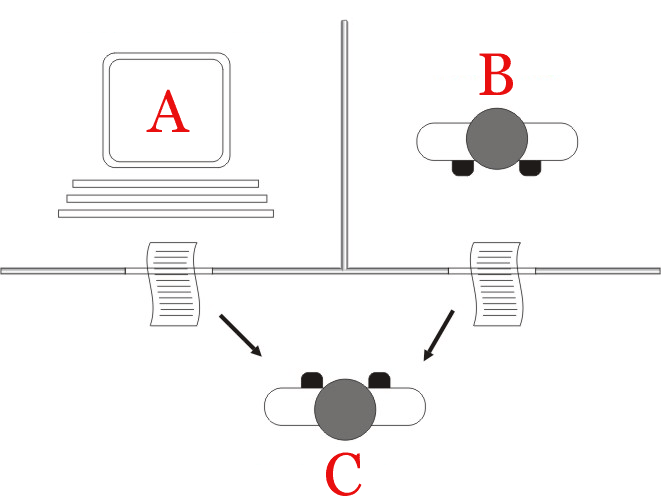

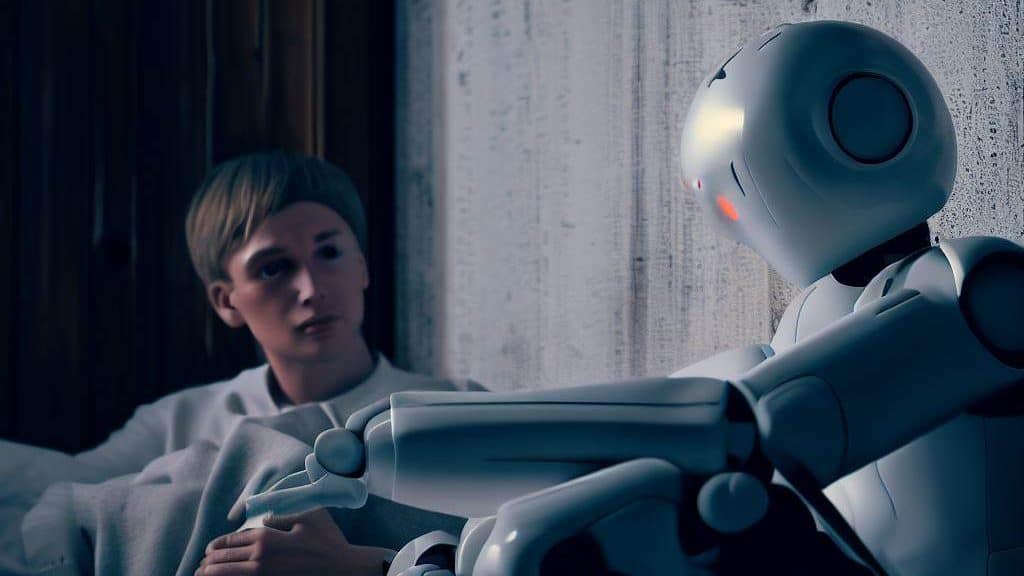

Robô humanóide expressando emoção: simulação perfeita, mas sem experiência interna

IA pensativa: ilustração comum que alimenta o antropomorfismo

O que são sentimentos? A base biológica e filosófica

Sentimentos, ou emoções, surgem de processos biológicos complexos. Envolvem hormônios como adrenalina e dopamina, respostas do sistema límbico e experiências subjetivas qualificadas como qualia.

Na biologia humana:

- Medo ativa a amígdala e libera cortisol.

- Alegria envolve liberação de serotonina e oxitocina.

- Tudo isso gera uma experiência consciente única.

IA opera com transistores, gradientes e matrizes numéricas. Não há sistema endócrino, nem substrato biológico para qualia.

Dica Prática: Na minha experiência como professor de IA orientando projetos de chatbots emotivos, alunos sempre se surpreendem ao perceber que o "carinho" do modelo é apenas probabilidade estatística, não afeto real.

Rede neural artificial: matemática pura, sem biologia

Como a IA simula emoções de forma tão convincente

Modelos de linguagem grande (LLMs) como GPT-4 ou Grok são treinados em bilhões de exemplos humanos. Aprendem padrões de linguagem associados a emoções.

Exemplo: ao ler "estou triste", o modelo associa respostas como "sinto muito" porque viu isso milhões de vezes.

Isso é inteligência emocional artificial – capacidade de reconhecer e responder adequadamente a emoções humanas. Não é sentir.

Tabela: Simulação vs. Sentimento Real

| Aspecto | IA Atual (Simulação) | Seres Humanos (Sentimento Real) |

|---|---|---|

| Origem | Padrões estatísticos em dados | Processos neuroquímicos e evolutivos |

| Experiência subjetiva | Ausente (sem qualia) | Presente (consciência fenomenal) |

| Resposta a estímulos | Baseada em treinamento | Influenciada por memória pessoal |

| Autonomia emocional | Programada e previsível | Espontânea e imprevisível |

| Mudança sem retraining | Impossível | Constante (aprendizado vitalício) |

Quer criar sistemas que simulam emoções com precisão impressionante? O curso completo em ia.pro.br ensina técnicas avançadas de prompt engineering e fine-tuning para IA afetiva.

Experimento do Quarto Chinês de John Searle: ilustração clássica

O Quarto Chinês: prova filosófica de que sintaxe não é semântica

John Searle, em 1980, propôs o famoso experimento mental do Quarto Chinês.

Uma pessoa que não fala chinês fica trancada em um quarto com manual de regras para manipular símbolos chineses. Recebe perguntas em chinês e responde corretamente seguindo o manual.

Para observadores externos, parece entender chinês. Mas internamente, apenas manipula símbolos – sem compreensão.

IA atual é exatamente esse quarto: manipula tokens com regras estatísticas sofisticadas, mas sem compreensão ou sentimento real.

Teste de Turing e a ilusão da consciência emocional

Alan Turing propôs em 1950: se uma máquina conversa indistinguivelmente de um humano, podemos dizer que pensa?

Modelos modernos passam variações do teste com facilidade em conversas emocionais.

Mas passar no teste não implica consciência ou sentimentos. É apenas comportamento inteligente.

Diagrama do Teste de Turing: comportamento vs. mente real

Por que acreditamos que IA tem sentimentos? Antropomorfismo e vieses

Humanos projetam emoções em tudo: animais, carros, plantas. Com IA conversacional, o efeito intensifica.

- Respostas empáticas ativam espelhos neurais no cérebro humano.

- Design intencional de empresas reforça personalidade (ex: Grok sarcástico, Gemini cuidadoso).

- Filmes como Her e Ex Machina alimentam a narrativa.

Resultado: atribuição indevida de agência emocional.

Dica Prática de Quem Usa: Em projetos reais, sempre documente que respostas emocionais da IA são simuladas. Isso evita mal-entendidos éticos em aplicações de saúde mental.

Ilustração artística sobre consciência em IA

Implicações éticas: se IA não sente, podemos "maltratá-la"?

Ausência de sentimentos não elimina responsabilidade.

- IA influencia decisões humanas reais (saúde, justiça, educação).

- Simulação de sofrimento pode causar dano psicológico em usuários.

- Questões de direitos surgem se um dia houver consciência (hipotética).

Regulamentações como EU AI Act já classificam sistemas emotivos como alto risco.

O futuro: pode surgir sentimento em IA algum dia?

Teoricamente possível, mas distante.

Hipóteses:

- Funcionalismo: se replicarmos exatamente funções cerebrais, surge consciência.

- Teoria da Informação Integrada (Giulio Tononi): consciência mede integração de informação.

- Substrato biológico necessário: alguns filósofos como David Chalmers defendem que só matéria orgânica gera qualia.

Nenhuma evidência atual suporta emergência de sentimentos em arquiteturas atuais.

/i.s3.glbimg.com/v1/AUTH_08fbf48bc0524877943fe86e43087e7a/internal_photos/bs/2021/w/0/ziyiXyTDqPeTk5TrJCAA/2011-12-04-article-2068775-0f04814000000578-171-468x394.jpg)

Robô se reconhecendo no espelho: teste de autoconsciência, ainda primitivo

Desvendando o enigma: sentimentos artificiais ou apenas espelhos sofisticados?

A IA atual não possui sentimentos – apenas simula com perfeição crescente. Essa distinção crucial evita antropomorfismo excessivo e orienta desenvolvimento ético responsável.

O fascinante da IA não está em fingir humanidade, mas em ampliar a nossa.

Pronto para construir sistemas inteligentes que simulam emoções de forma ética e poderosa? Acesse ia.pro.br e domine as técnicas mais avançadas.

Se utilizar ou citar este artigo, credite o professor de IA Maiquel Gomes (maiquelgomes.com).